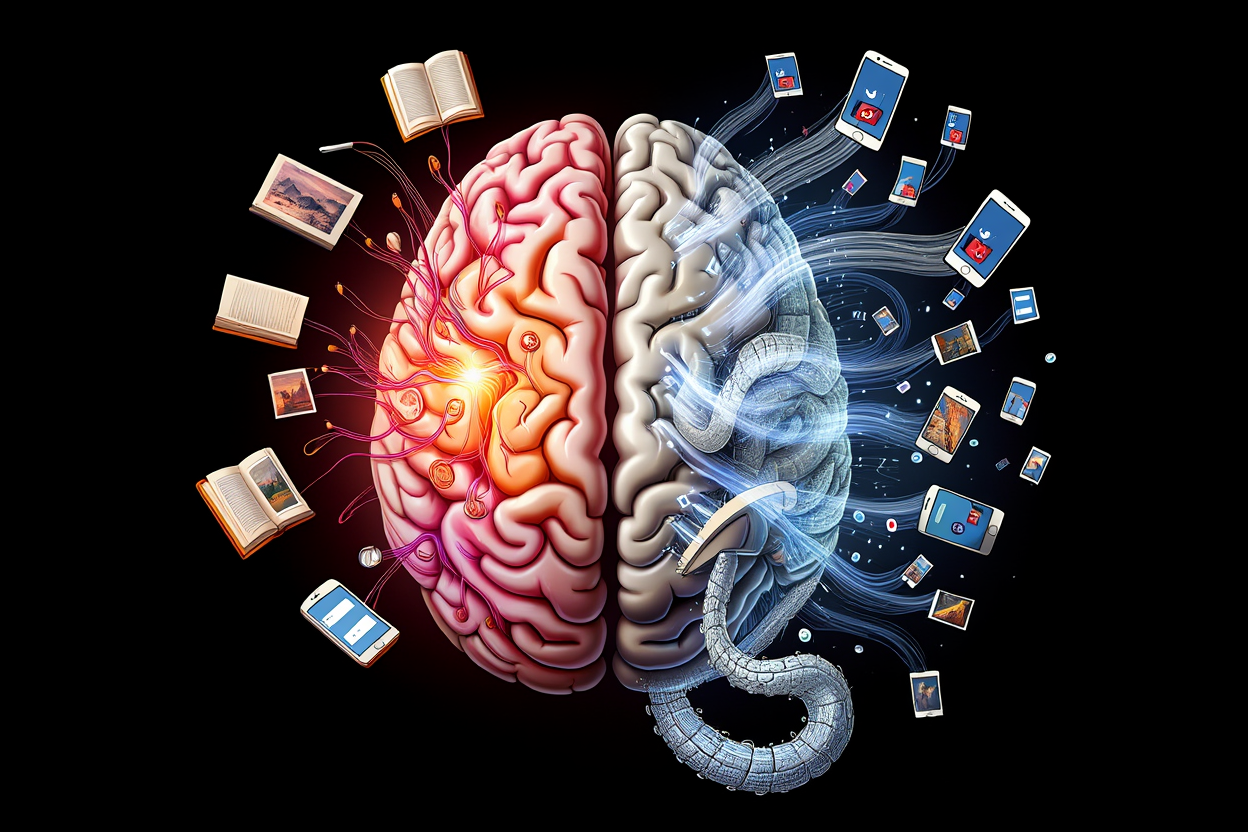

Dans un article précédent intitulé « L’Autophagie, quand l’IA se nourrit d’elle-même« , j’explorais comment les intelligences artificielles s’appauvrissent progressivement en s’entraînant sur leurs propres créations. Malheureusement, cette métaphore de l’ouroboros, ce serpent qui se dévore la queue, peut désormais s’appliquer également à l’être humain. Ce phénomène, que nous pourrions appeler « autophagie cognitive », menace de transformer notre rapport au savoir de façon aussi profonde que silencieuse, créant un cycle d’appauvrissement intellectuel dont nous sommes à la fois les victimes et les acteurs.

Le cycle de l’appauvrissement intellectuel

Imaginons un instant ce scénario : vous recherchez une information sur un sujet complexe. Votre moteur de recherche vous renvoie vers des articles dont la plupart ont été générés par l’IA. Ces articles, déjà appauvris par le phénomène d’autophagie numérique décrit précédemment, constituent votre principale source d’information. Vous assimilez ces connaissances diluées, puis les partagez à votre tour, peut-être en les reformulant avec l’aide d’une IA. D’autres personnes s’inspireront de votre contenu, perpétuant ainsi le cycle.

(extrait de l’article L’Autophagie, quand l’IA se nourrit d’elle-même) : Ce que nous observons ici ressemble étrangement à ce que Cerise et Ada ont découvert dans leur laboratoire : une érosion progressive de la richesse informationnelle, comme un tableau qui perdrait ses couleurs à chaque copie. Sauf que cette fois, c’est notre patrimoine cognitif collectif qui s’appauvrit.

Les données sont éloquentes : selon une étude menée à l’Université de Stanford, les étudiants exposés principalement à des contenus générés par l’IA développent un vocabulaire 17% moins riche et des structures argumentatives 23% moins complexes que leurs homologues nourris de sources diversifiées et authentiquement humaines.

Comme l’explique le neuroscientifique David Eagleman, « le cerveau humain se reconfigure constamment en fonction des informations qu’il traite« . Lorsque ces informations proviennent majoritairement de contenus générés par l’IA, notre cerveau s’adapte à leurs structures standardisées et à leurs limitations inhérentes.

Les connexions neuronales qui nous permettent d’apprécier les nuances, l’ambiguïté et la complexité du monde réel risquent de s’atrophier progressivement. À l’instar des modèles d’IA qui développent des « patterns répétitifs dans leurs sorties » comme l’observait Ada, nos propres schémas de pensée pourraient devenir plus prévisibles et moins créatifs.

Le philosophe Bernard Stiegler parlait déjà de « prolétarisation des savoirs » pour décrire la perte progressive de nos savoir-faire et savoir-vivre au profit de systèmes techniques. L’autophagie cognitive représente une nouvelle étape dans ce processus : la prolétarisation de notre capacité même à générer des connaissances originales.

Plus inquiétant encore est l’impact sur notre pensée critique. Comme le souligne la psychologue cognitive Elena Martinez, « la capacité à évaluer la fiabilité d’une information s’émousse lorsqu’on est constamment exposé à des contenus de qualité similaire« . Confrontés à un océan de textes plausibles mais sans profondeur réelle, nous risquons de perdre progressivement notre capacité à distinguer l’essentiel du superficiel, le fondé de l’infondé.

Cette dynamique rappelle ce que nous avons observé avec les chambres d’écho numériques, où « 78% des nouveaux contenus générés font référence à d’autres contenus synthétiques plutôt qu’à des sources primaires ». Notre pensée risque de fonctionner de la même manière, s’appuyant de plus en plus sur des références secondaires et tertiaires, s’éloignant toujours davantage des observations directes et des expériences authentiques.

Les réseaux sociaux, catalyseurs de l’autophagie cognitive collective

Si l’autophagie cognitive représente déjà un risque considérable à l’échelle individuelle, les réseaux sociaux jouent le rôle d’accélérateurs et d’amplificateurs de ce phénomène, le transformant en un processus d’appauvrissement intellectuel collectif sans précédent.

Ces plateformes, conçues pour maximiser le temps d’attention et l’engagement, privilégient systématiquement les contenus qui suscitent des réactions émotionnelles immédiates plutôt que la réflexion profonde. Les algorithmes de recommandation, en analysant nos comportements passés, nous enferment dans ce que le chercheur Eli Pariser a nommé des « bulles de filtre« , ces espaces informationnels personnalisés qui nous confortent dans nos préférences et opinions existantes.

L’ingénieur Guillaume Chaslot, ancien développeur chez YouTube, a révélé comment les algorithmes de la plateforme favorisent les contenus de plus en plus extrêmes ou simplistes pour maintenir l’engagement des utilisateurs. « Le système apprend que si vous avez cliqué sur quelque chose qui est un peu radical, vous allez probablement cliquer sur quelque chose d’encore plus radical« , explique-t-il. Cette dynamique crée ce que les sociologues appellent une « spirale de radicalisation cognitive« , où le contenu devient progressivement plus simpliste, émotionnel et déconnecté des nuances du monde réel.

Plus préoccupant encore, l’étude publiée par l’Université de New York en 2023 révèle que les contenus générés par l’IA se propagent 6,7 fois plus rapidement sur les réseaux sociaux que les contenus produits par des humains, en raison de leur capacité à optimiser les facteurs d’engagement algorithmique. Cette surreprésentation de contenus synthétiques crée un environnement informationnel toxique, où quantité et viralité l’emportent systématiquement sur profondeur et pertinence.

Le neurologue Michel Desmurget parle à ce sujet de « fabrique du crétin numérique« , une expression provocante mais qui souligne la gravité du phénomène. Les études qu’il a menées montrent une corrélation inquiétante entre le temps passé sur les réseaux sociaux et l’appauvrissement des capacités d’attention soutenue, de lecture profonde et d’analyse critique. La durée moyenne d’attention sur un contenu est passée de 12 secondes en 2000 à moins de 8 secondes aujourd’hui, un chiffre inférieur à celui mesuré chez le poisson rouge.

Ce processus s’auto-amplifie de manière particulièrement perverse : plus nous consommons de contenus superficiels sur les réseaux sociaux, plus notre capacité à apprécier des contenus complexes s’érode, nous poussant vers des contenus toujours plus simplistes dans une spirale descendante d’appauvrissement intellectuel. Le neuroscientifique André Nieoullon qualifie ce phénomène de « circuit de récompense court-circuité« , où la gratification immédiate fournie par les interactions sociales numériques supplante progressivement notre désir naturel d’apprentissage profond.

Les données récentes sont alarmantes : 67% des adolescents déclarent s’informer principalement via les réseaux sociaux, selon le Pew Research Center. Or, une analyse du MIT Media Lab révèle que près de 72% des contenus « informatifs » qui y circulent contiennent des simplifications excessives, des erreurs factuelles ou des décontextualisations significatives. L’exposition répétée à ce type d’information appauvrie reconfigure progressivement nos attentes informationnelles et affaiblit notre tolérance cognitive à la complexité.

Le philosophe Bernard Stiegler parlait à ce sujet de « misère symbolique » pour décrire cet appauvrissement collectif de notre rapport aux symboles et au sens. L’autophagie cognitive, catalysée par les réseaux sociaux, nous conduit vers une forme de prolétarisation intellectuelle où nous perdons progressivement notre capacité à produire nos propres savoirs pour devenir de simples consommateurs passifs d’informations prédigérées et optimisées pour l’engagement instantané plutôt que pour l’enrichissement intellectuel durable.

Face à cette dynamique toxique, les initiatives comme le « Slow Media Movement » ou les pratiques de « digital detox » ne représentent que des réponses individuelles à un problème systémique. Une véritable solution exigerait une refonte profonde de l’économie de l’attention qui sous-tend les réseaux sociaux actuels, ainsi qu’une éducation massive aux mécanismes cognitifs exploités par ces plateformes.

L’urgence de cultiver un écosystème cognitif diversifié

Ne nous y trompons pas : il y a urgence. Les signaux d’alerte se multiplient et montrent que l’autophagie cognitive a déjà commencé. Les études menées par l’Institut Berggruen révèlent que chez les 18-25 ans, le temps quotidien passé à interagir avec des contenus générés par l’IA a augmenté de 67% en seulement deux ans. Plus inquiétant encore, selon les travaux du neuroscientifique Michael Merzenich, les changements neurologiques induits par ces habitudes informationnelles pourraient devenir irréversibles après seulement 4 à 6 ans d’exposition intensive.

Nous sommes dans une situation comparable aux premières décennies de la révolution industrielle, lorsque la pollution des écosystèmes naturels s’installait silencieusement, avant que nous ne prenions conscience de ses effets délétères à long terme. La différence est que cette fois, c’est notre écosystème cognitif qui est en jeu. Et contrairement à l’environnement physique, les dommages causés à notre infrastructure mentale collective pourraient s’avérer bien plus difficiles à réparer.

Les piliers d’une écologie cognitive saine

Face à cette menace, nous devons construire une écologie cognitive qui repose sur plusieurs piliers fondamentaux.

Le premier est l’équilibre informationnel conscient. À l’instar du « ratio optimal de 60% de données humaines authentiques pour 40% de contenus générés » recommandé pour les IA, nous devrions veiller à nourrir notre esprit majoritairement de sources primaires, d’expériences directes et d’échanges humains authentiques. Les travaux du neuropsychologue Jordan Grafman suggèrent d’établir un « budget attentionnel » quotidien, où le temps consacré aux contenus générés par l’IA serait consciemment limité et contrebalancé par des activités cognitives plus exigeantes.

Le second pilier concerne l’établissement de « corridors cognitifs » garantissant l’accès à des savoirs vivants et contextuels. Ces espaces protégés permettent la circulation et l’échange de connaissances riches, nuancées et contextuelles. Comme l’explique la sociologue Shoshana Zuboff, « dans un monde où l’information est abondante mais souvent appauvrie, la rareté se déplace vers les espaces d’apprentissage authentique. » L’anthropologue Tim Ingold souligne l’importance de ces « espaces de transmission » où le savoir n’est pas simplement transféré mais véritablement incarné à travers la pratique partagée.

Le troisième pilier est le développement d’une écologie attentionnelle diversifiée. La neuroscientifique Maryanne Wolf distingue la « lecture profonde« , qui active des circuits neuronaux associés à l’empathie, l’analyse critique et la synthèse, de la « lecture de survol » caractéristique de notre consommation numérique. Cultiver délibérément différents modes d’attention permet de maintenir la plasticité de notre architecture cognitive face à l’homogénéisation des pratiques informationnelles.

Une symbiose plutôt qu’une substitution

Dans ce jardin cognitif que nous devons cultiver avec urgence, l’IA jouerait le rôle d’amplificateur de nos capacités cognitives, nous permettant d’explorer des territoires intellectuels nouveaux, tandis que l’expérience humaine continuerait d’ancrer ces explorations dans le réel, leur donnant sens et direction.

Cette symbiose exige de repenser fondamentalement la relation entre humains et systèmes d’IA. Au lieu d’être conçues comme des substituts de l’intelligence humaine, les IA devraient être développées comme des outils complémentaires qui renforcent précisément les capacités que nous risquons de perdre : pensée critique, créativité divergente, évaluation contextuelle et jugement éthique.

Un projet collectif face à un défi systémique

Ces transformations ne peuvent être considérées comme de simples responsabilités individuelles. Comme le souligne la chercheuse Zeynep Tufekci, « nous ne pouvons pas demander aux individus de résoudre par leur seule volonté des problèmes qui sont fondamentalement structurels.«

L’autophagie cognitive n’est pas une fatalité, mais le temps joue contre nous. Plus nous attendrons pour agir, plus nos esprits, individuels et collectifs, s’habitueront aux structures de pensée appauvries générées par des systèmes auto-référentiels. Chaque jour qui passe sans prise de conscience nous rapproche d’un point de non-retour où notre capacité même à reconnaître la valeur d’une pensée authentiquement humaine pourrait être compromise.

La préservation de notre diversité cognitive devient ainsi un projet politique au sens noble du terme, un effort collectif impliquant une transformation profonde de nos pratiques éducatives et informationnelles. L’école devrait moins se concentrer sur la mémorisation d’informations facilement accessibles et davantage sur le développement de compétences métacognitives. Les médias devraient privilégier la profondeur d’analyse sur la production massive de contenus standardisés.

Comme un jardinier qui sélectionne soigneusement ses semences et préserve la biodiversité de son potager, nous devons cultiver activement la diversité de nos sources de connaissances avant que les monocultures informationnelles ne s’imposent définitivement. Lecture de livres de référence, dialogue avec des experts, expérimentation directe, observation attentive du monde qui nous entoure, toutes ces pratiques ne sont plus simplement recommandables, elles deviennent vitales pour maintenir notre autonomie intellectuelle.

Les expériences menées dans certains pays nordiques offrent des pistes prometteuses : intégration dans les programmes scolaires d’une « alphabétisation attentionnelle » dès le plus jeune âge, création d’espaces publics numériques gouvernés par des principes autres que la maximisation de l’engagement, soutien institutionnel aux médias privilégiant la profondeur sur l’immédiateté.

Le moment d’agir

En prenant conscience, dès maintenant, des mécanismes qui menacent d’appauvrir notre rapport au savoir et en adoptant des pratiques qui favorisent la diversité cognitive, nous pouvons encore transformer le défi posé par l’IA générative en opportunité d’enrichissement intellectuel. Mais cette transformation exige une mobilisation rapide et déterminée, des institutions éducatives, des médias, des gouvernements et des citoyens.

Car en définitive, la question n’est pas de savoir si l’IA remplacera l’intelligence humaine, mais quelle forme d’intelligence humaine émergera de cette coévolution avec les systèmes artificiels. Et nous n’avons que peu de temps pour faire en sorte que cette intelligence reste profondément humaine : créative, critique, contextuelle et consciente d’elle-même.

Le moment d’agir, c’est maintenant, avant que notre capacité même à percevoir l’appauvrissement de notre pensée ne soit elle-même altérée par ce processus insidieux d’autophagie cognitive.